文章主题:,人工智能, ChatGPT, 大语言模型

随着研究人员不断涌入先进的 AI 聊天机器人的「新世界」,像《Nature》这样的出版商需要承认它们的合法用途,并制定明确的指导方针以避免滥用。

机器之心报道,编辑:蛋酱。

🎨🚀人工智能的进步犹如一股无形的语言风暴,正在创造出令人惊叹的语句艺术。它已悄然提升到一个层次,让机器生成的文字几乎难以分辨于人类智慧的结晶。🌍💻科学家们早已拥抱聊天机器人这一创新伙伴,它们不仅是思维的催化剂,帮助整理思路,还能生成深度的工作反馈,编写代码如丝般流畅,甚至能精准摘要学术文献。👩🔬💼这些智能工具不仅提升了效率,更在知识的海洋中点亮了一盏导航灯。🌍

🌟2022年11月震撼发布!ChatGPT引领AI聊天机器人潮流,将大型语言模型大众化!💡由硅谷创新力量OpenAI驱动,这款革命性的工具让每个人都能无缝接入,无需专业知识。🚀免费开放,打破技术壁垒,无论你是程序员还是新手,ChatGPT都将成为你的得力助手。🌍快来体验,开启智能对话的新篇章!🌐

🎉🚀 数百万用户热衷于 AI 写作实验,每份生成的作品都可能带来惊喜或震撼!🔍创作的乐趣与潜在风险并存,引发了广泛的情感共鸣。在这个科技日新月异的时代,人们对这类工具的好奇心与忧虑交织,既惊叹其力量又担忧其影响。👩💻👨💻 让我们深入探讨,探索人工智能写作的无限可能与未来挑战。记得关注SEO优化哦!🌍

ChatGPT 超能力的喜与忧

🌟ChatGPT的强大无需多言,它已证明能胜任各类写作任务,从学生作文到学术论文,再到解决问题和编写代码。它的能力覆盖广泛,仿佛一位全能笔友,无论何时何地都能提供精准且高质量的输出。🌍无论是医学知识的深入解析,还是商业策略的深度总结,甚至是法律条款的严谨解读,ChatGPT都能游刃有余,轻松应对。🎓当然,它并非替代人类智慧的工具,而更像是一个强大的辅助,帮助我们提升效率,获取信息。👩💻想要卓越,ChatGPT无疑是你的得力助手。欲了解更多,只需轻轻一搜,SEO优化关键词已为你准备齐全。📚

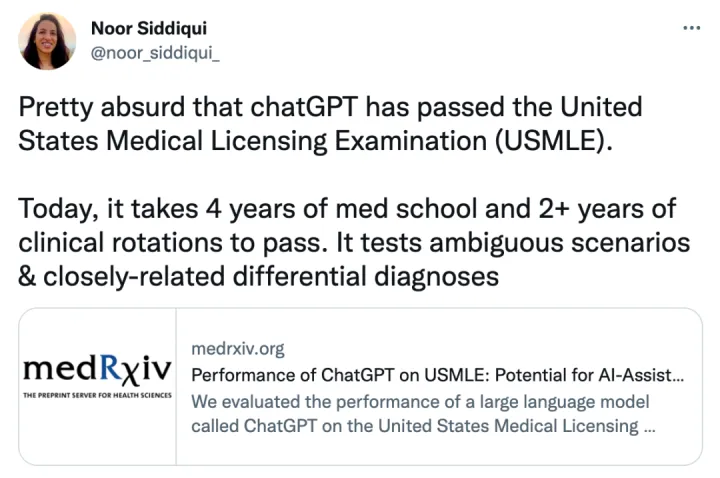

🌟 ChatGPT的医疗知识突破性进展!🚀 最近的研究揭示,这款人工智能已展现出强大的模拟能力,仿佛正逐步迈向医学界的权威认证——USMLE。🏆 这可不是简单的模拟游戏,它以四年医学院的专业训练为底蕴,加上至少两年的临床实战经验为后盾,展现出了令人瞩目的学习效能和适应性。🎓尽管这并非直接通过考试,但ChatGPT的进步无疑对医疗教育和行业带来了挑战与机遇。它不仅刷新了我们对AI在医学领域应用的认知,也可能促使传统教育模式进行革新。💻欲了解更多关于ChatGPT如何颠覆医疗界的细节,敬请关注未来相关报道,让我们共同见证科技与医学的深度交汇!🔥

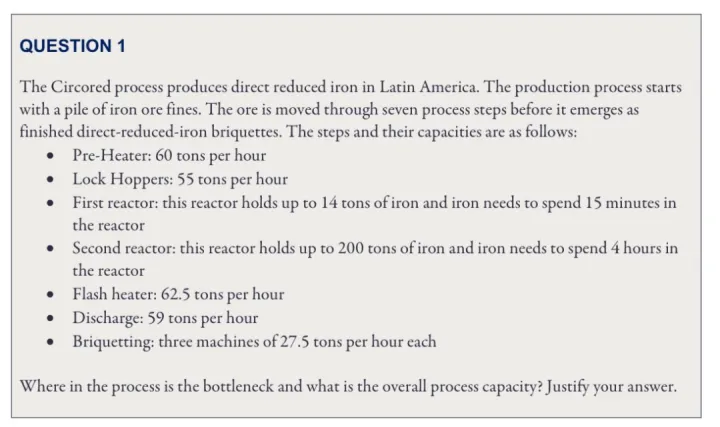

🌟 ChatGPT 已经展现出令人惊叹的能力,它不仅轻松通过了沃顿商学院的 MBA 期末运营挑战,而且在极短的时间内展现了卓越的解答速度——仅需一秒,就实现了无人能及的「瞬间突破」!这样的成就无疑是对人工智能智慧的强力证明。虽然这并非最艰巨的考验,但它所展示的高效与创新,无疑是教育领域和技术进步的一大亮点🌟

在司法考试这件事上,ChatGPT 仍然展现出了非凡的能力。在美国,要想参加律师专业执照考试,大多数司法管辖区要求申请人完成至少七年高等教育,包括在经认可的法学院学习三年。此外,大多数应试者还需要经过数周至数月的考试准备。尽管投入了大量的时间和资金,大约 20% 的应试者在第一次考试中的得分仍然低于通过考试的要求。

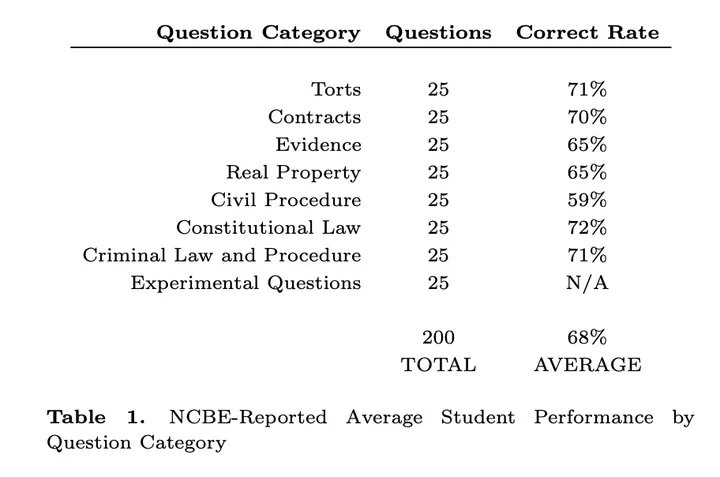

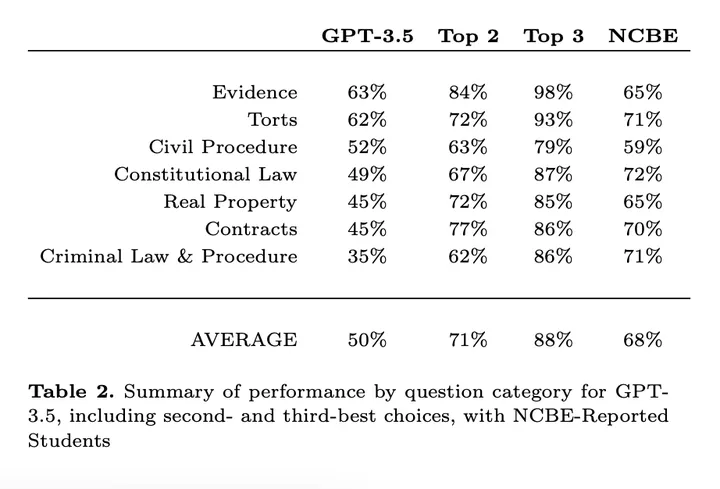

但在最近的一项研究中,研究者发现,对于最佳 prompt 和参数,ChatGPT 在完整的 NCBE MBE 练习考试中实现了 50.3% 的平均正确率,大大超过了 25% 的基线猜测率,并且在证据和侵权行为方面都达到了平均合格率。ChatGPT 的答案排名也与正确率高度相关;其 Top 2 和 Top 3 的选择分别有 71% 和 88% 的正确率。作者认为,这些结果强烈表明大型语言模型将在不久的将来通过律师资格考试的 MBE 部分。

ChatGPT 编写的研究摘要水平也很高,以至于科学家们发现很难发现这些摘要是由计算机编写的。反过来说,对整个社会来说,ChatGPT 也可能使垃圾邮件、勒索软件和其他恶意输出更容易产生。

目前为止,语言模型生成的内容还不能完全保证其正确性,甚至在一些专业领域的错误率是很高的。如果无法区分人工编写内容和 AI 模型生成内容,那么人类将面临被 AI 误导的严重问题。尽管 OpenAI 试图为这款聊天机器人的行为设限,但用户已经找到了绕过限制的方法。

学术界的担心

学术研究界最大的担忧是,学生和科学家可以欺骗性地把大模型写的文本当作自己写的文本,或者以简单化的方式使用大模型(比如进行不完整的文献综述),生成一些不可靠的工作。

在近期西北大学 Catherine Gao 等人的一项研究中,研究者选取一些发表在美国医学会杂志(JAMA)、新英格兰医学杂志(NEJM)、英国医学期刊(BMJ)、《柳叶刀》和《Nature Medicine》上的人工研究论文,使用 ChatGPT 为论文生成摘要,然后测试审稿人是否可以发现这些摘要是 AI 生成的。

实验结果表明,审稿人仅正确识别了 68% 的生成摘要和 86% 的原始摘要。他们错误地将 32% 的生成摘要识别为原始摘要,将 14% 的原始摘要识别为 AI 生成的。审稿人表示:「要区分两者出奇地困难,生成的摘要比较模糊,给人一种公式化的感觉。」

甚至还有一些预印本和已发表的文章已经将正式的作者身份赋予 ChatGPT。一些学术会议率先公开反对,比如机器学习会议 ICML 就表示过:「ChatGPT 接受公共数据的训练,这些数据通常是在未经同意的情况下收集的,这会带来一系列的责任归属问题。」

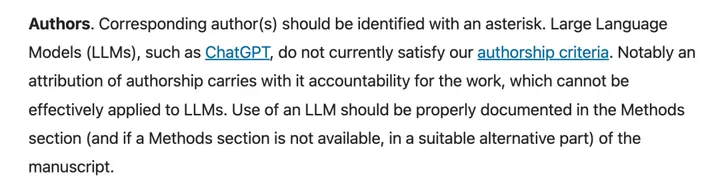

因此,现在或许是研究人员和出版商制定以道德方式使用大型语言模型的基本规则的时候了。《自然》杂志公开表示,已经与所有 Springer Nature 期刊共同制定了两条原则,并且这些原则已被添加到现有的作者指南中:

首先,任何大型语言模型工具都不会被接受作为研究论文的署名作者。这是因为任何作者的归属权都伴随着对工作的责任,而 AI 工具不能承担这种责任。

第二,使用大型语言模型工具的研究人员应该在方法或致谢部分记录这种使用。如果论文不包括这些部分,可以用引言或其他适当的部分来记录对大型语言模型的使用。

作者指南:https://www.nature.com/nature/for-authors/initial-submission

通讯作者应以星号标明。大型语言模型(LLM),如 ChatGPT,目前不符合我们的作者资格标准。值得注意的是,作者的归属带有对工作的责任,这不能有效地适用于 LLM。LLM 的使用应该在稿件的方法部分(如果没有方法部分,则在合适的替代部分)进行适当记录。据了解,其他科学出版商也可能采取类似的立场。「我们不允许 AI 被列为我们发表的论文的作者,并且在没有适当引用的情况下使用 AI 生成的文本可能被视为剽窃,」《Science》系列期刊的主编 Holden Thorp 说。

为什么要制定这些规则?

编辑和出版商可以检测由大型语言模型生成的文本吗?现在,答案是「或许可以」。如果仔细检查的话,ChatGPT 的原始输出是可以被识别出来的,特别是当涉及的段落超过几段并且主题涉及科学工作时。这是因为,大型语言模型是根据它们的训练数据和它们所看到的 prompt 中的统计学关联来生成词汇模式的,这意味着它们的输出可能看起来非常平淡,或者包含简单的错误。此外,它们还不能引用资料来记录他们的输出。

但在未来,人工智能研究人员也许能够解决这些问题 —— 例如,已经有一些实验将聊天机器人与引用资源的工具联系起来,还有一些实验用专门的科学文本训练聊天机器人。

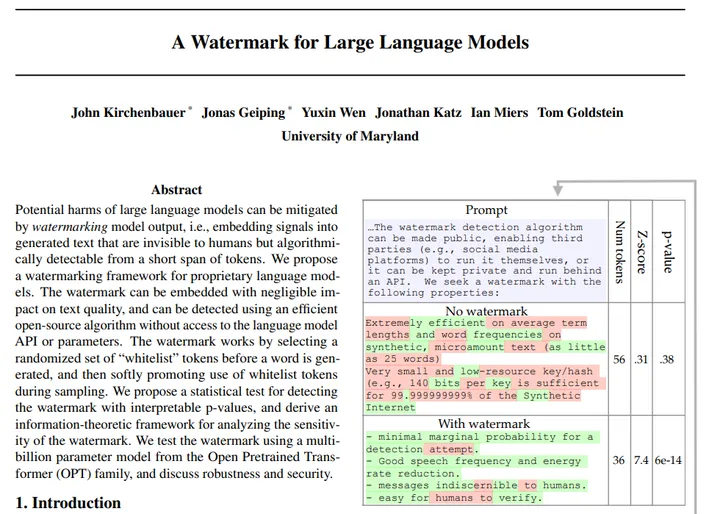

一些工具声称可以检测出大型语言模型生成的输出,《自然》杂志的出版商 Springer Nature 就是开发这项技术的团队之一。但是大型语言模型将会迅速改进。这些模型的创建者希望能够以某种方式为其工具的输出添加水印,尽管这在技术上可能不是万无一失的。

近期较火的一篇为大型语言模型输出添加「水印」的论文。论文地址:https://arxiv.org/pdf/2301.10226v1.pdf

从最早的时候起,「科学」就主张对方法和证据公开透明,无论当时流行的是哪种技术。研究人员应该扪心自问,如果他们或他们的同事使用的软件以一种根本不透明的方式工作,那么产生知识的过程所依赖的透明度和可信度如何保持。

这就是为什么《自然》杂志制定了这些原则:最终,研究方法必须透明,作者必须诚实、真实。毕竟,这是科学赖以发展的基础。

参考链接:https://www.nature.com/articles/d41586-023-00191-1

https://www.nature.com/articles/d41586-023-00107-z

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!