文章主题:AI, 公开信, 行业领袖, 签名

今日突发,又一封由多位AI领域行业领袖署名的公开信发出。

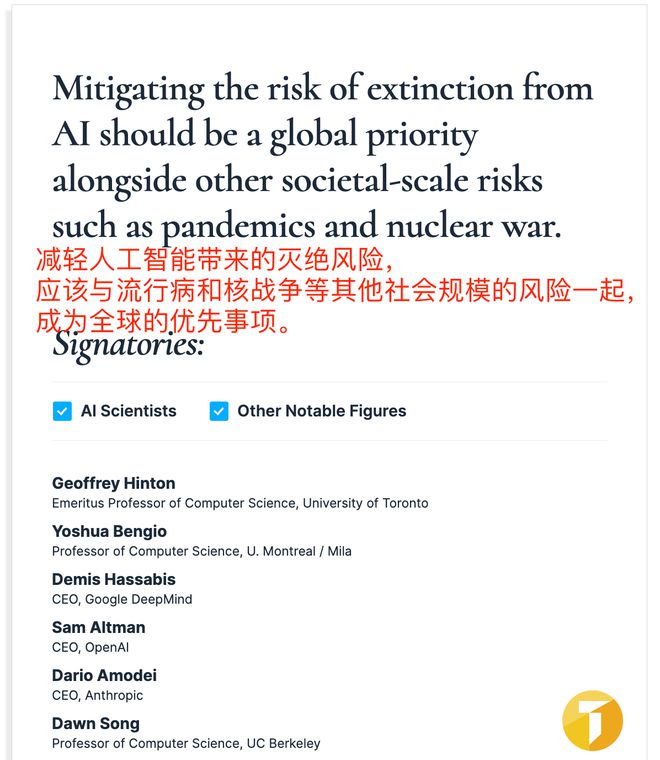

以下是我对您提供的内容进行的改写:我们需要意识到,降低人工智能灭绝的风险应该被视为全球性的首要任务,这应该与大流行病和核战争等其他社会规模的风险一样受到关注。

在这份备受瞩目的名单中,我们看到了众多行业巨擘的签名,其中包括OpenAI首席执行官Sam Altman、DeepMind首席执行官Demis Hassabis以及Anthropic首席执行官Dario Amode。此外,我们还发现了一些曾在图灵奖领域获得荣誉的专家,如获得图灵奖的Geoffrey Hinton和Yoshua Bengio。继续向下浏览名单,我们会发现许多我国知名的学者,例如中国科学院自动化研究所人工智能伦理与治理研究中心主任曾毅,以及清华大学副教授詹仙园等。

今年3月,科技界发生了一件引人关注的事件,那就是一份由马斯克、Stability AI首席执行官等人为代表的公开信的发布。该封信在短时间内引起了广泛的共鸣,并在科技圈内引发了热议。在这封信中,他们呼吁所有从事AI研究的人员暂时停止对更先进AI模型的开发和研究,至少暂停6个月。此外,他们还提倡整个AI领域以及政策制定者们都共同参与制定一套全面的人工智能治理体系,以确保人工智能技术的发展能够得到有效的监督和审查。仅仅两个月之后,再次出现了一封类似的警告信。这充分说明,对于AI技术的开发与应用,我们需要保持高度的警惕,同时也需要采取积极的措施来确保其能够造福人类社会,而不是带来潜在的风险和威胁。

在近期,OpenAI的CEO Sam Altman在参加完关于AI安全和监管问题的听证会之后,不久便联同其他知名公司,发出了一封警惕性强烈的警告信。目前,包括Google和Microsoft在内的诸多大型科技企业,都纷纷投入AI的研究和开发中,然而,它们所生产的软件却可以在任何人的手机和电脑上运行,这就引发了人们对于这些大型企业能否确保数据安全的疑虑。回顾过去,AI相关的诈骗案件频发,而人类尚未制定出相应的法律法规来限制AI的“无序发展”,这也使得如何在技术进步的同时,将其置于可控制的范围之内,成为了我们面临的一项新挑战。

在本文中,我们将重点关注 Safe AI 声明关于人工智能风险的内容。Safe AI 是一个致力于确保人工智能系统安全性和可靠性的非营利性组织。他们的声明强调了人工智能在发展过程中可能带来的潜在风险,并呼吁各方共同努力降低这些风险。以下是 Safe AI 声明的主要要点:首先,Safe AI 指出人工智能系统的普及和发展可能导致一系列负面后果。包括算法偏见、数据隐私泄露、自动化决策的不透明性以及人工智能在军事和执法领域的潜在滥用等。为了应对这些问题,Safe AI 提倡建立一个公平、透明和负责任的人工智能发展环境。其次,Safe AI 强调需要在技术层面和法律层面上确保人工智能系统的安全性。这包括通过透明度和可解释性原则来提高人工智能算法的公正性,同时加强相关法律法规的制定和执行,确保人工智能在遵循道德和伦理原则的前提下发挥作用。此外,Safe AI 鼓励研究人员、政策制定者、企业和公民共同参与人工智能风险的防范。这意味着各方的共同努力,以确保人工智能技术的广泛应用不会给社会带来不可承受的风险。最后,Safe AI 提出了一个具体的行动计划,以实现人工智能系统的安全和可持续发展。这个计划包括开展人工智能风险评估、设立跨部门的合作机制、加强国际合作以及公众教育和培训等。总之,Safe AI 的声明表明了人工智能领域中存在的风险,以及确保人工智能安全和可持续发展的紧迫性。我们作为文章写作高手,应该关注这个问题,积极参与讨论,共同推动人工智能技术的健康发展。

P1:公开信

P2:声明

P3:加入署名

P4:马斯克等人呼吁暂停AI研究

P5:出席听证会的Sam Altman

P6:All in AI的Google

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号AIGC666aigc999或上边扫码,即可拥有个人AI助手!