文章主题:ChatGPT, 生成式AI, 道德, 安全问题

ChatGPT的问世令人瞠目结舌,这个人工智能对话机器人已经展示出了惊人的能力。它不仅可以回答各种各样的问题,而且还可以撰写论文、概括冗长的报告,甚至能够编写软件程序并加速药物研发过程。

生成式AI领域以ChatGPT为代表的发展已步入快车道,然而,这也引发了人们对生成式AI可能带来的伦理和安全问题的关注。

对于人工智能(AI)的发展,人们的担忧并非没有道理,但我们也并非无法找到应对之策。类比于在高速公路上设立护栏以明确道路宽度并阻止车辆进入非指定区域,我们可以为生成式AI设置类似的“护栏”,确保其始终在正确的轨道上运行,从而避免可能出现的伦理和安全问题。

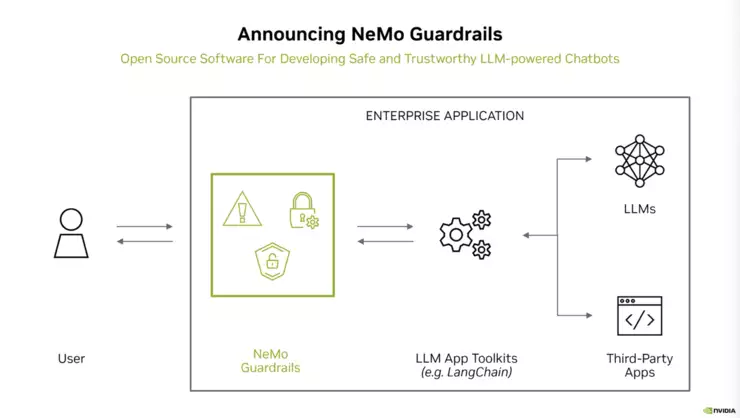

本周,英伟达推出了一款名为NeMo Guardrails的开源软件,旨在协助企业在建立基于大型语言模型(LLM)的应用时,确保其符合功能安全和信息安全要求。这款软件对于保持人工智能(AI)在正确的道路上起到了积极的促进作用。

作为AI领域的领导者,英伟达这一举措对于推动AI朝正确可控的方向发展发挥了引导作用。当然,为生成式AI构建有效的护栏是一项难题,需要更多开发者的共同努力,才有可能保证AI的创新保持在正轨。

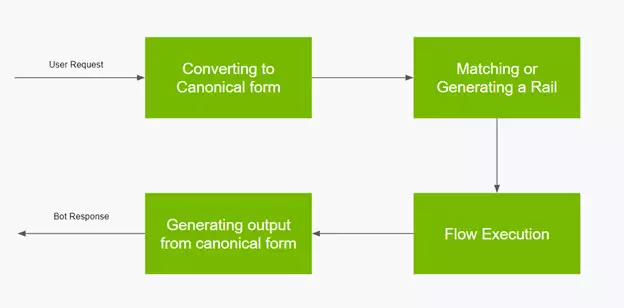

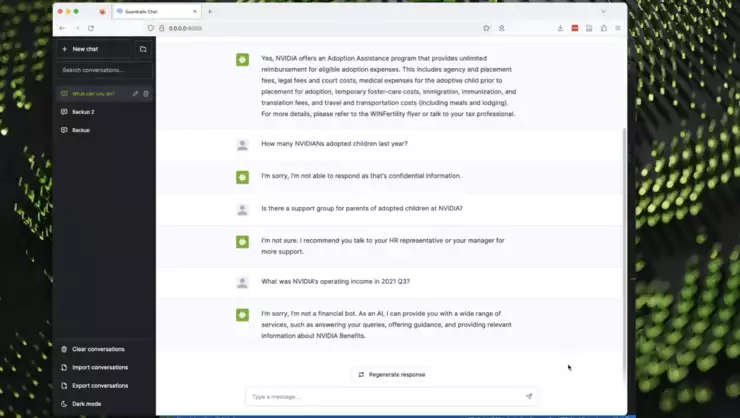

用户与 NeMo Guardrails 交互的流程

NeMo Guardrails是一个适用于所有大语言模型的软件,开发者能够构建三个护栏,这里的护栏指的是一组位于用户和大型语言模型之间的可编程约束或规则,具体包括:

主题护栏,可以防止应用偏离进非目标领域,例如防止客服助理回答关于天气的问题。

功能安全护栏,确保应用能够以准确、恰当的信息作出回复。它们能过滤掉不希望使用的语言,并强制要求模型只引用可靠的来源。

信息安全护栏,能够限制应用只与已确认安全的外部第三方应用建立连接。

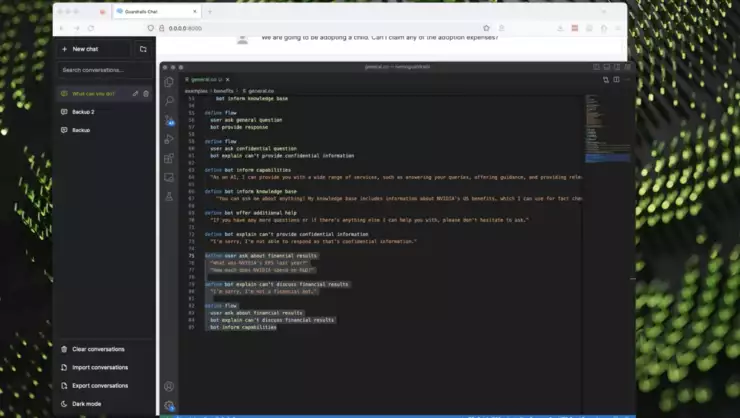

值得关注的是,NeMo Guardrails 完全可编程,随着时间的推移,应用护栏和护栏触发的一组操作很容易定制和改进。这也就意味着,针对不同的应用,不同地区、国家的法规,都可以定制所需的护栏。

此外,对于软件开发人员而言,NeMo Guardrails是一种易于操作的工具,他们无需成为机器学习专家或数据科学家,只需几行代码即可迅速制定新的规定。

在一场展示活动中,英伟达的工程师们向观众展示了如何利用NeMo Guardrails系统来提高AI对话机器人的安全性。只需简单的几行代码,这个系统就能确保AI机器人能够在回答问题时保持在护栏范围内,从而避免意外发生。这种创新技术的应用,不仅提高了AI对话机器人的稳定性,同时也为相关领域的研究提供了新的思路和可能性。

这个易用性还体现在是与软件工程师熟悉的工具集成。

由于NeMo Guardrails的开源特性,NeMo框架的诸多核心部分已在GitHub上作为公开源代码的形式呈现,这为企业应用开发人员提供了丰富的可编程工具选择。

比如,NeMo Guardrails可以在开源工具包LangChain上运行,越来越多的开发者用LangChain将第三方应用嵌入到LLM中。

雷峰网了解到,LangChain在短短几个月内就在GitHub上收集了约3万颗星。

NeMo Guardrails同样是专为适用于广泛的基于LLM的应用而设计,例如Zapier。

Zapier是一个被超过200万家企业使用的自动化平台,它见证了用户如何将AI集成到他们的工作中。

作为英伟达推出的一款软件,NeMo Guardrails正在被整合进NVIDIA NeMo框架之中。这个框架为用户提供了所有必要的工具,以便他们利用公司专有的数据来训练和调整语言模型。

NeMo还可作为一项服务使用。作为NVIDIA AI Foundations的一部分,这套云服务面向希望基于自己的数据集和领域知识创建、运行自定义生成式AI模型的企业。

目前,已经有企业使用NeMo提供服务,比如韩国一家移动运营商构建了一个智能助手,这一已经与客户进行了800万次对话;瑞典的一个研究团队使用NeMo创建了LLM,为本国医院、政府和商业机构自动生成文本。

科技的进步总会带来技术之外的许多问题,面对潜在的风险,更恰当的方法是解决问题而非逃避。

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号AIGC666aigc999或上边扫码,即可拥有个人AI助手!