文章主题:编辑, 编著, 创作

提示:欢迎点击上方「Pubpeer」↑关注我们!

提示:欢迎点击上方「Pubpeer」↑关注我们!

编者按

最新、最快、最真实的科研匿名评价论文报道;关注高校院所科研生态,欢迎提供新闻线索。联系邮箱:Pubpeer@qq.com

科学家和出版专家担心,聊天机器人日益复杂可能会破坏研究的完整性和准确性。作者:Ted Hsu/Alamy

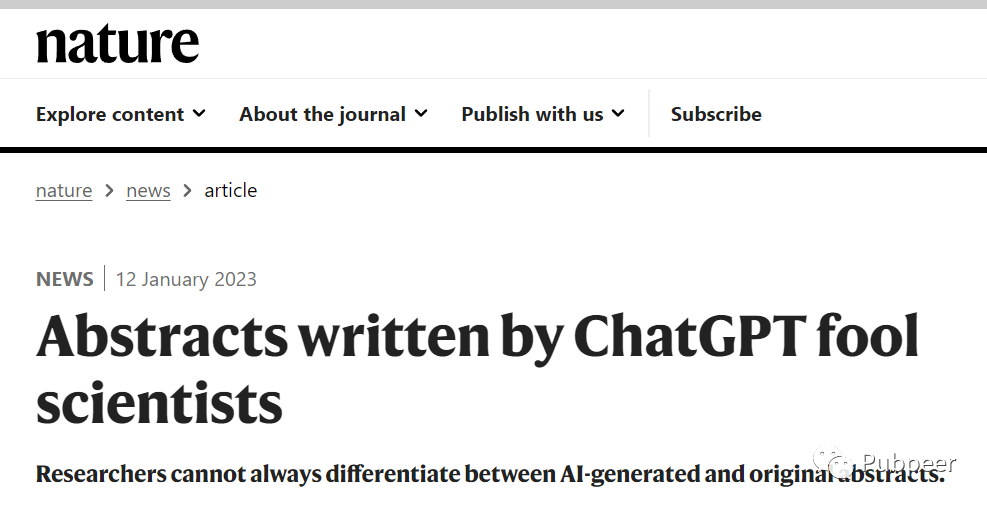

根据bioRxiv服务器12月1日发布的预印本,人工智能(AI)聊天机器人可以写出如此令人信服的假研究论文摘要,以至于科学家们往往无法发现它们。 1 .研究人员对这对科学的影响存在分歧。

“我非常担心,”桑德拉·瓦赫特说,她在英国牛津大学研究技术和监管,没有参与这项研究。她补充说:“如果我们现在处于一种专家无法确定什么是真的或假的情况下,我们就失去了一个中间人,我们迫切需要这个中间人来指导我们处理复杂的话题。”

聊天机器人ChatGPT可以创建逼真的智能文本来响应用户提示。 realistic and intelligent-sounding text in response to user prompts.这是一个”大型语言模型”,一个基于神经网络的系统,通过消化大量现有的人工生成的文本来学习执行任务。 large language model , a system based on neural networks that learn to perform a task by digesting huge amounts of existing human-generated text.总部位于加州旧金山的软件公司OpenAI于11月30日发布了该工具,它是免费使用的。

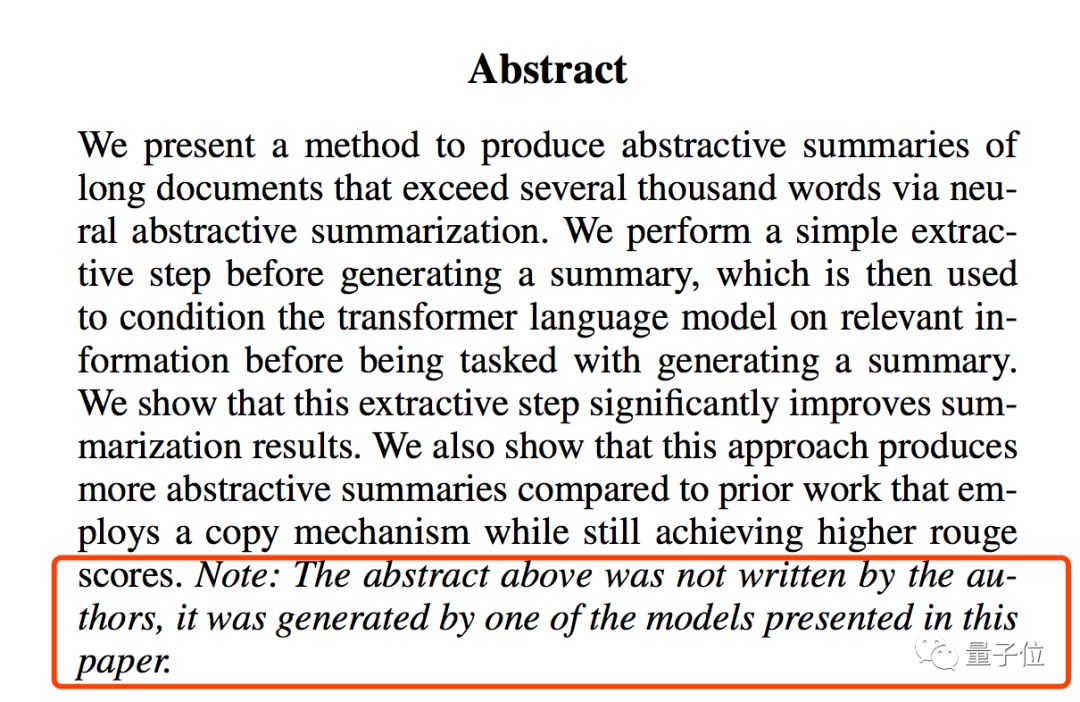

自从它发布以来,研究人员一直在努力解决围绕它使用的伦理问题,因为它的许多输出很难与人类书写的文本区分开来。grappling with the ethical issues surrounding its use, because much of its output can be difficult to distinguish from human-written text.科学家们发表了由ChatGPT撰写的预印本2和社论3。 2 and an editorial 3 written by ChatGPT.现在,伊利诺斯州芝加哥西北大学的凯瑟琳·高领导的一个小组已经使用ChatGPT生成人工研究论文摘要,以测试科学家是否能发现它们。

研究人员要求聊天机器人根据发表在 JAMA、新英格兰医学杂志、BMJ、柳叶刀和自然医学杂志上的精选文章撰写50篇医学研究摘要。然后,他们通过剽窃检测器和人工智能输出检测器,将这些摘要与原始摘要进行比较,并让一组医学研究人员找出伪造的摘要。

在监考下

ChatGPT生成的摘要顺利通过了剽窃检查:原创性得分的中位数为100%,这表明没有发现剽窃行为。人工智能输出检测器发现了66%生成的摘要。但人类评审员也没有做得更好:他们仅正确识别了68%的生成摘要和86%的真实摘要。他们错误地将32%的生成摘要识别为真实的摘要,将14%的真实摘要识别为生成摘要。

“ChatGPT写出了可信的科学摘要,”Gao和他的同事在预印本中说。“使用大型语言模型来帮助科学写作的道德和可接受的界限仍有待确定。”

Wachter说,如果科学家不能确定研究是否真实,可能会有“可怕的后果”。除了给研究人员带来问题,他们可能会被拉下有缺陷的调查路线,因为他们正在阅读的研究是捏造的,还有“对整个社会的影响,因为科学研究在我们的社会中发挥着如此巨大的作用”。她补充说,例如,这可能意味着基于研究的政策决定是不正确的。

但是新泽西州普林斯顿大学的计算机科学家Arvind Narayanan说:“任何严肃的科学家都不太可能使用ChatGPT生成摘要。”他补充说,生成的摘要是否能被检测到是“无关紧要的”。“问题是这个工具是否能生成一个准确和令人信服的摘要。它不能,所以使用ChatGPT的好处是微不足道的,而缺点是显著的,”他说。

Irene Solaiman研究人工智能的社会影响, Hugging Face,总部位于纽约和巴黎的人工智能公司,担心科学思维对大型语言模型的依赖。她补充说:”这些模型是根据过去的信息训练出来的,社会和科学的进步往往来自于与过去不同的思维,或者说是开放的思维。”

作者建议,那些评估科学交流的人,比如研究论文和会议记录,应该制定政策来杜绝人工智能生成文本的使用。如果机构选择在某些情况下允许使用这种技术,它们就应该制定明确的披露规则。本月早些时候,第四十届国际会议 机器学习,一个将于7月在夏威夷檀香山举行的大型AI会议,宣布禁止使用ChatGPT和其他AI语言工具撰写的论文。

索莱曼补充说,在虚假信息可能危及人们安全的领域,如医学,期刊可能必须采取更严格的方法来验证信息的准确性。

纳拉亚南表示,这些问题的解决方案不应集中在聊天机器人本身,“而应集中在导致这种行为的不正当动机上,比如大学在招聘和晋升审查时,不考虑论文的质量或影响”。

doi:

https://doi.org/10.1038/d41586-023-00056-7

来源:公众号pubpeer原创,转载请注明出处,若没注明pubpeer公众号出处,构成侵权。

推荐文章:

济宁市第一人民医院10月被撤6篇论文:编造研究过程、代写代投

2022年3月18日,科技部通报54起学术不端论文调查处理通报

12家医院43人上榜!开年大整治!国家卫健委通报医学论文造假名单

2021年8月份以来,卫健委已经公布了12批的国内医学机构的科研诚信案件调查处理结果。

国家卫健委10月15日通报,部分机构医学科研诚信案件调查处理结果

国家卫健委曝光10起医学论文造假、科研失信案件 严惩涉事人员

声明:转载此文是出于传递更多信息之目的。若有来源标注错误或侵犯了您的合法权益,请作者持权属证明与本网联系,我们将及时更正、删除,谢谢

Pubpeer,专注科研工作者。关注请长按上方二维码。投稿、合作、转载授权事宜请联系本号,回复2023,微信ID:pubpeer992 或邮箱:Pubpeer@qq.com

更多推荐学术不端!多处图片胶图造假,哈佛医学院一篇PNAS论文被撤稿!图片重复!Nature子刊 Cell Death Differ论文被编辑撤稿图片数据造假,江苏省药用植物生物技术重点实验室J Thorac Dis论文被撤稿一区Biomater. Sci(IF=7.59)论文被撤稿,来自华中大同济医学院附属协和医院,作者同意撤稿又一篇Nature论文结论引起Pubpeer读者质疑

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号AIGC666aigc999或上边扫码,即可拥有个人AI助手!